CooperActiveSLAM: Fusión sensorial y SLAM activo cooperativo para entornos de gran escala

Entidad financiadora: Ministerio de Ciencia e Innovación

Referencia: DPI2009-07144

Duración: 2010-2012

Descripción

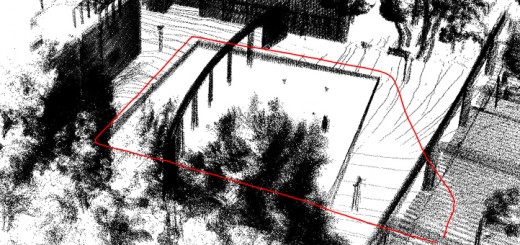

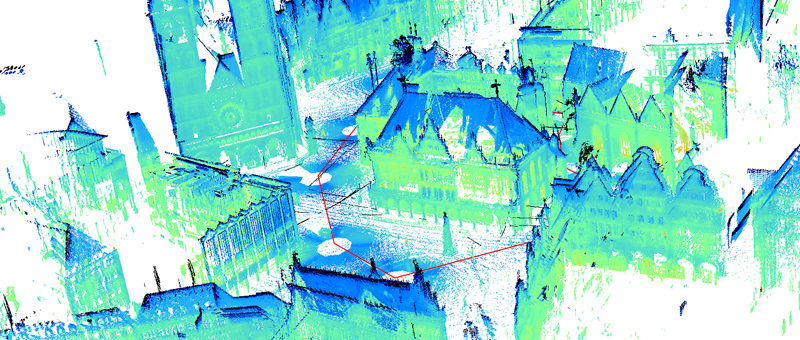

La finalidad de este proyecto es diseñar una combinación de técnicas de navegación robótica y visión artificial para la mejora de la resolución del problema del SLAM en entornos de gran escala. Pretendemos abordar este problema desde dos frentes: realizando una mejor asociación de datos a partir de fusión sensorial (distintos sensores: cámaras 2D, láser 3D y cámaras estéreo) y creando mapas que permitan manejar dicha información (heterogénea y numerosa) de una manera eficiente. Este punto de partida nos va a servir para enfocar un problema conocido como Active SLAM, que nos permitirá obtener las acciones a realizar por el robot para maximizar la resolución del SLAM. Los entornos a los que nos enfrentamos entran dentro de los denominados de gran escala, por la densidad de datos a tratar.

Objetivos

Desarrollar nuevos métodos eficaces y robustos de asociación de datos para el problema del SLAM. Por un lado se desarrollarán nuevas técnicas en la extracción de características (landmarks) a partir de datos 3D (por ejemplo, adaptación de los métodos tradicionales de extracción de características 2D a 3D) y por otro se investigará en la fusión de datos sensoriales para obtener características más robustas. Esto último nos permitirá el uso de varios sistemas sensores para mejorar la calidad de la asociación de datos.

Desarrollar un sistema para manejar un mapa jerárquico híbrido que incorpore todas aquellas características provenientes de distintas fuentes sensoriales, principalmente 3D. Desarrollar técnicas para la incorporación de nuevas características que pueden aparecer en sitios ya visitados. Estas características podrán provenir de objetos no vistos previamente (oclusión) o bien por nuevos objetos no presentes anteriormente. Todo esto se aplicará a entornos de gran escala, donde la enorme cantidad de datos disponibles hacen inviable las técnicas previas.

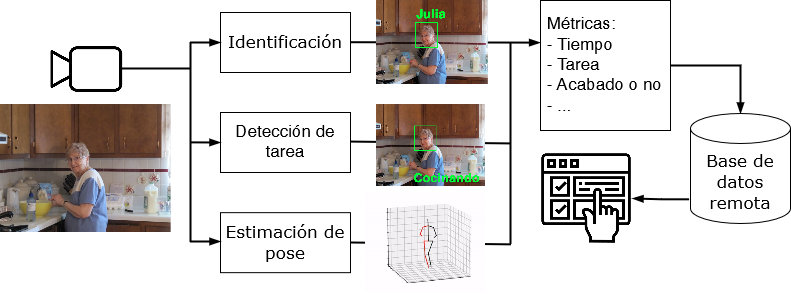

Crear nuevos métodos para la detección y reconocimiento de objetos móviles dentro del SLAM.

Desarrollar nuevas técnicas de SLAM activo para la exploración eficiente de entornos de gran escala. En este objetivo nos planteamos realizar SLAM activo cooperativo, permitiendo realizar el trabajo entre varios robots móviles.

Personal

- Miguel Angel Cazorla (Investigador principal)

- Domingo Gallardo Doctor

- Otto Colomina

- Diego Viejo Hernando

- Cristina Pomares

- Antonio Botía

- Eduardo Nebot

- Juan Nieto

- Andrés Hernández

Resultados del proyecto

La finalidad de este proyecto es diseñar una combinación de técnicas de navegación robótica y visión artificial para la mejora de la resolución del problema del SLAM en entornos de gran escala. Pretendemos abordar este problema desde dos frentes: realizando una mejor asociación de datos a partir de fusión sensorial (distintos sensores: cámaras 2D, láser 3D y cámaras estéreo) y creando mapas que permitan manejar dicha información (heterogénea y numerosa) de una manera eficiente. Este punto de partida nos va a servir para enfocar un problema conocido como Active SLAM, que nos permitirá obtener las acciones a realizar por el robot para maximizar la resolución del SLAM. Los entornos a los que nos enfrentamos entran dentro de los denominados de gran escala, por la densidad de datos a tratar.

Durante el desarrollo del proyecto, hemos identificado y abordado diversos problemas a solucionar. El primero de ellos es que cuando disponemos de datos densos (provenientes de sensores 3D, como láser 3D, cámaras RGBD como la Kinect, etc.) se requiere una reducción de dichos datos para que el procesamiento sea manejable. Para ello, hemos propuesto el uso de un tipo de red neuronal, la Growing Neural Gas (GNG), aplicada directamente sobre los datos 3D. Este tipo de red nos permite presevar la topología de los datos, a la vez que se reduce el número de puntos y el ruido asociado. Hemos realizado un estudio exhaustivo de la aplicación de la red sobre distintas fuentes sensoriales 3D (láser 3D, cámara SR4000, datos Kinect), demostrando su validez y comprobando los límites de su aplicabilidad.

Una de las conclusiones extraídas de este estudio ha sido que el número de neuronas necesario para su aplicación conlleva un coste computacional elevado. Por ello, hemos introducido el uso de la paralelización disponible con las tarjetas gráficas GPU. Esto nos ha permitido acelerar enormemente su aplicación y nos ha abierto una línea de trabajo poco explorada por nuestro grupo. Por otro lado, hemos desarrollado métodos de SLAM topológico, que ha permitido crear mapas jerárquicos, permitiendo también la localización de manera precisa usando exclusivamente información visual. También hemos desarrollado un sistema que permite el manejo de datos heterogéneos (imágenes, datos 3D, características 2D, etc.) y así poder dar soporte a los métodos de fusión sensorial.

Tesis defendidas

- Anna María Romero Cortijo: Mapeado y localización topológicos mediante información visual. Supervisor: Miguel Cazorla. Date: may 2013.

Congresos

- M. Cazorla, D. Viejo, and C. Pomares, «study of the sR4000 camera,» in Workshop of physical agents, 2010.

[Bibtex]@inproceedings{cazorla2010study, author = {Cazorla, Miguel and Viejo, Diego and Pomares, Cristina}, booktitle = {Workshop of Physical Agents}, organization = {Red de Agentes Fisicos}, title = {{study of the sR4000 camera}}, year = {2010} } - V. Morell, M. Cazorla, D. Viejo, sergio Orts-Escolano, and J. Garcia-Rodriguez, «A study of registration techniques for 6DoF sLAM,» in Ccia, 2012, p. 143–150.

[Bibtex]@InProceedings{Morell2012A, author = {Morell, Vicente and Cazorla, Miguel and Viejo, Diego and Orts-Escolano, sergio and Garcia-Rodriguez, Jose}, title = {{A study of registration techniques for 6DoF sLAM}}, booktitle = {CCIA}, year = {2012}, editor = {Riano, David and Onaindia, Eva and Cazorla, Miguel}, volume = {248}, series = {Frontiers in Artificial Intelligence and Applications}, pages = {143--150}, publisher = {IOs Press}, isbn = {978-1-61499-138-0} } - J. Munoz, D. Pastor, P. Gil, P. T. santiago Mendez, and M. Cazorla, «Using a RGB-D camera for 6DoF sLAM.,» in Ccia, 2012, p. 143–150.

[Bibtex]@inproceedings{MunozPGMC12, author = {Munoz, Jose and Pastor, Daniel and Gil, Pablo and Mendez, santiago T Puente and Cazorla, Miguel}, booktitle = {CCIA}, editor = {Riano, David and Onaindia, Eva and Cazorla, Miguel}, isbn = {978-1-61499-138-0}, keywords = {dblp}, pages = {143--150}, publisher = {IOs Press}, series = {Frontiers in Artificial Intelligence and Applications}, title = {{Using a RGB-D camera for 6DoF sLAM.}}, url = {http://dblp.uni-trier.de/db/conf/ccia/ccia2012.html{\#}MunozPGMC12}, volume = {248}, year = {2012} } - J. Navarrete-sanchez, D. Viejo, and M. Cazorla, «Portable 3D laser-camera calibration system with color fusion for sLAM,» in International symposium on robotics, isr, 2012.

[Bibtex]@inproceedings{Navarrete2012Portable, author = {Navarrete-sanchez, Javier and Viejo, Diego and Cazorla, Miguel}, booktitle = {International symposium on robotics, IsR}, title = {{Portable 3D laser-camera calibration system with color fusion for sLAM}}, year = {2012} } - sergio Orts–Escolano, J. Garcia-Rodriguez, D. Viejo, M. Cazorla, V. Morell, and J. serra, «6DoF pose estimation using Growing Neural Gas Network,» in Proceedings of 5th international conference on cognitive systems, 2012.

[Bibtex]@inproceedings{Orts2012b, author = {Orts--Escolano, sergio and Garcia-Rodriguez, Jose and Viejo, Diego and Cazorla, Miguel and Morell, Vicente and serra, Jose}, booktitle = {proceedings of 5th International Conference on Cognitive systems}, title = {{6DoF pose estimation using Growing Neural Gas Network}}, year = {2012} } - A. Romero and M. Cazorla, «An Improvement of Topological Mapping Using a Graph-Matching Based Method with Omnidirectional Images.,» in Ccia, 2010, p. 311–320.

[Bibtex]@inproceedings{romero2010improvement, author = {Romero, Anna and Cazorla, Miguel}, booktitle = {CCIA}, pages = {311--320}, title = {{An Improvement of Topological Mapping Using a Graph-Matching Based Method with Omnidirectional Images.}}, year = {2010} } - A. Romero and M. Cazorla, «Finding nodes into a topological map using visual features,» in International symposium on robotics, isr, 2012.

[Bibtex]@inproceedings{Romero2012Finding, author = {Romero, Anna and Cazorla, Miguel}, booktitle = {International symposium on robotics, IsR}, title = {{Finding nodes into a topological map using visual features}}, year = {2012} } - A. Romero and M. Cazorla, «Topological visual mapping in robotics,» in Proceedings of the 5th international conference on spatial cognition, 2012.

[Bibtex]@inproceedings{Romero2012Topological, author = {Romero, Anna and Cazorla, Miguel}, booktitle = {Proceedings of the 5th International Conference on spatial Cognition}, title = {{Topological visual mapping in robotics}}, year = {2012} } - D. Viejo and M. Cazorla, «A framework for managing heterogenous sensor data in a single map,» in Ieee intelligent vehicles symposium, 2012.

[Bibtex]@inproceedings{Viejo20123A, author = {Viejo, Diego and Cazorla, Miguel}, booktitle = {IEEE Intelligent Vehicles symposium}, title = {{A framework for managing heterogenous sensor data in a single map}}, year = {2012} }

Revistas

-

![[DOI]](https://www.rovit.ua.es/wp-content/plugins/papercite/img/external.png) sergio Orts-Escolano, J. Garcia-Rodriguez, D. Viejo, M. Cazorla, and V. Morell, «GPGPU implementation of growing neural gas: Application to 3D scene reconstruction,» Journal of parallel and distributed computing, vol. 72, iss. 10, p. 1361–1372, 2012.

sergio Orts-Escolano, J. Garcia-Rodriguez, D. Viejo, M. Cazorla, and V. Morell, «GPGPU implementation of growing neural gas: Application to 3D scene reconstruction,» Journal of parallel and distributed computing, vol. 72, iss. 10, p. 1361–1372, 2012.

[Bibtex]@Article{Orts20121361, author = {Orts-Escolano, sergio and Garcia-Rodriguez, Jose and Viejo, Diego and Cazorla, Miguel and Morell, Vicente}, title = {{GPGPU implementation of growing neural gas: Application to 3D scene reconstruction}}, journal = {Journal of Parallel and Distributed Computing}, year = {2012}, volume = {72}, number = {10}, pages = {1361--1372}, abstract = {self-organising neural models have the ability to provide a good representation of the input space. In particular the Growing Neural Gas (GNG) is a suitable model because of its flexibility, rapid adaptation and excellent quality of representation. However, this type of learning is time-consuming, especially for high-dimensional input data. since real applications often work under time constraints, it is necessary to adapt the learning process in order to complete it in a predefined time. This paper proposes a Graphics Processing Unit (GPU) parallel implementation of the {\{}GNG{\}} with Compute Unified Device Architecture (CUDA). In contrast to existing algorithms, the proposed {\{}GPU{\}} implementation allows the acceleration of the learning process keeping a good quality of representation. Comparative experiments using iterative, parallel and hybrid implementations are carried out to demonstrate the effectiveness of {\{}CUDA{\}} implementation. The results show that {\{}GNG{\}} learning with the proposed implementation achieves a speed-up of 6 ?{\{}o{\}} compared with the single-threaded {\{}CPU{\}} implementation. {\{}GPU{\}} implementation has also been applied to a real application with time constraints: acceleration of 3D scene reconstruction for egomotion, in order to validate the proposal. }, doi = {http://dx.doi.org/10.1016/j.jpdc.2012.05.008}, issn = {0743-7315}, keywords = {Egomotion}, url = {http://www.sciencedirect.com/science/article/pii/s0743731512001268} } -

![[DOI]](https://www.rovit.ua.es/wp-content/plugins/papercite/img/external.png) D. Viejo, J. Garcia, M. Cazorla, D. Gil, and M. Johnsson, «Using GNG to improve 3D feature extraction. Application to 6DoF egomotion,» Neural networks, vol. 32, p. 138–146, 2012.

D. Viejo, J. Garcia, M. Cazorla, D. Gil, and M. Johnsson, «Using GNG to improve 3D feature extraction. Application to 6DoF egomotion,» Neural networks, vol. 32, p. 138–146, 2012.

[Bibtex]@article{Viejo2012138, abstract = {several recent works deal with 3D data in mobile robotic problems, e.g. mapping or egomotion. Data comes from any kind of sensor such as stereo vision systems, time of flight cameras or 3D lasers, providing a huge amount of unorganized 3D data. In this paper, we describe an efficient method to build complete 3D models from a Growing Neural Gas (GNG). The {\{}GNG{\}} is applied to the 3D raw data and it reduces both the subjacent error and the number of points, keeping the topology of the 3D data. The {\{}GNG{\}} output is then used in a 3D feature extraction method. We have performed a deep study in which we quantitatively show that the use of {\{}GNG{\}} improves the 3D feature extraction method. We also show that our method can be applied to any kind of 3D data. The 3D features obtained are used as input in an Iterative Closest Point (ICP)-like method to compute the 6DoF movement performed by a mobile robot. A comparison with standard {\{}ICP{\}} is performed, showing that the use of {\{}GNG{\}} improves the results. Final results of 3D mapping from the egomotion calculated are also shown. }, annote = {selected Papers from {\{}IJCNN{\}} 2011}, author = {Viejo, Diego and Garcia, Jose and Cazorla, Miguel and Gil, David and Johnsson, Magnus}, doi = {http://dx.doi.org/10.1016/j.neunet.2012.02.014}, issn = {0893-6080}, journal = {Neural Networks}, keywords = {6DoF registration}, number = {0}, pages = {138--146}, title = {{Using GNG to improve 3D feature extraction. Application to 6DoF egomotion}}, url = {http://www.sciencedirect.com/science/article/pii/s0893608012000433}, volume = {32}, year = {2012} } -

![[DOI]](https://www.rovit.ua.es/wp-content/plugins/papercite/img/external.png) D. Viejo, J. Garcia-Rodriguez, and M. Cazorla, «A study of a soft computing based method for 3D scenario reconstruction,» Applied soft computing, vol. 12, iss. 10, p. 3158–3164, 2012.

D. Viejo, J. Garcia-Rodriguez, and M. Cazorla, «A study of a soft computing based method for 3D scenario reconstruction,» Applied soft computing, vol. 12, iss. 10, p. 3158–3164, 2012.

[Bibtex]@article{Viejo20123158, abstract = {several recent works deal with 3D data in mobile robotic problems, e.g., mapping. Data comes from any kind of sensor (time of flight, Kinect or 3D lasers) that provide a huge amount of unorganized 3D data. In this paper we detail an efficient approach to build complete 3D models using a soft computing method, the Growing Neural Gas (GNG). As neural models deal easily with noise, imprecision, uncertainty or partial data, {\{}GNG{\}} provides better results than other approaches. The {\{}GNG{\}} obtained is then applied to a sequence. We present a comprehensive study on {\{}GNG{\}} parameters to ensure the best result at the lowest time cost. From this {\{}GNG{\}} structure, we propose to calculate planar patches and thus obtaining a fast method to compute the movement performed by a mobile robot by means of a 3D models registration algorithm. Final results of 3D mapping are also shown. }, author = {Viejo, Diego and Garcia-Rodriguez, Jose and Cazorla, Miguel}, doi = {http://dx.doi.org/10.1016/j.asoc.2012.05.025}, issn = {1568-4946}, journal = {Applied soft Computing}, keywords = {3D feature extraction}, number = {10}, pages = {3158--3164}, title = {{A study of a soft computing based method for 3D scenario reconstruction}}, url = {http://www.sciencedirect.com/science/article/pii/s1568494612002803}, volume = {12}, year = {2012} }